ΣΥΜΒΑΙΝΕΙ ΤΩΡΑ

-

Πίτερ Μαγιάρ προς Φ.Μερτς: «Θέλω να διώξω τον Ταμάς Σούλιοκ από την προεδρία της Ουγγαρίας – Είναι μαριονέτα»

-

Θλίψη στον καλλιτεχνικό κόσμο: Πέθανε ξαφνικά η τραγουδίστρια Έλενα Ιωάννου – Τι αναφέρει ο Σπύρος Μπιμπίλας

-

Το νεό δημόσιο νοσοκομείο του Ελ Σαλβαδόρ που ο Α.Γεωργιάδης θα ήθελε να είχε παρουσιάσει ως δικό του… έργο

-

Δημοσία δαπάνη η κηδεία του Α.Χαμενεΐ: Τριήμερες εκδηλώσεις προς τιμήν του με 15-20 εκατ.πολίτες να δίνουν το παρών

-

Επίθεση του Ρίτσαρντ Γκιρ στον Ν.Τραμπ: «Είναι παρανοϊκός και καταστρέφει ό,τι όμορφο υπάρχει»

-

Νετανιάχου: «Θα εξαλείψουμε το τρομοκρατικό καθεστώς της Τεχεράνης»

-

Μέλανι Μουσίγιο: Η «καυτή» Ιταλίδα fashion blogger πόζαρε με μπικίνι και «έριξε» το Instagram (φωτογραφίες)

-

Tραγικός θάνατος για μια ηλικιωμένη στις Αφίδνες: Φορτηγό την παρέσυρε και την σκότωσε

-

Ανείπωτη θλίψη στην κηδεία του Μάριου Οικονόμου: «Ράκος» οι συγγενείς & φίλοι του ποδοσφαιριστή (φωτογραφίες)

-

Καταστροφική «επιδρομή» αρκούδας σε κτηνοτροφική μονάδα της Κοζάνης – Νεκρά 15 πρόβατα

Ο Τζόφρι Χίντον, γνωστός ως «ο νονός της τεχνητής νοημοσύνης (AI)» παραιτήθηκε από τη δουλειά του, προειδοποιώντας για τους αυξανόμενους κινδύνους που φέρνει η ανάπτυξη της για τους ανθρώπους!

Ο 75χρονος Χίντον, ανακοίνωσε την παραίτησή του από την Google σε μια δήλωση στους New York Times, λέγοντας ότι τώρα μετανιώνει για τη δουλειά του.

Είπε στο BBC ότι ορισμένοι από τους κινδύνους που προκύπτουν από τα chatbots Τεχνητής Νοημοσύνης (AI) ήταν «αρκετά τρομακτικοί».

«Αυτή τη στιγμή, δεν είναι πιο έξυπνα από εμάς, από όσο μπορώ να πω. Αλλά νομίζω ότι σύντομα μπορεί να γίνουν»

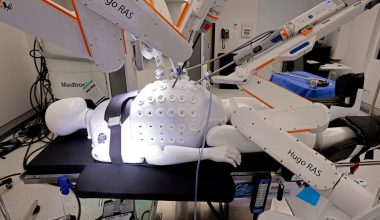

Πρόσφατα Ρεπουμπλικανοί και Δημοκρατικοί εισήγαγαν τροπολογία που απαγορεύει στην τεχνητή νοημοσύνη (TN) να λαμβάνει αποφάσεις εκτόξευσης πυρηνικών πυραύλων στο πλαίσιο της διαδικασίας πυρηνικής διοίκησης και ελέγχου των ΗΠΑ!

Το νομοσχέδιο εισήχθη στη Βουλή των Αντιπροσώπων και στη Γερουσία ταυτόχρονα. Οι αντιπρόσωποι Ted Lieu, Donald Beyer, Jr. και Ken Buck εισήγαγαν το νομοσχέδιο στη Βουλή, ενώ ο γερουσιαστής Edward Markey εισήγαγε τη συνοδευτική νομοθεσία στη Γερουσία.

Είναι η πρώτη φορά που επισήμως το αμερικανικό πολιτικό σύστημα αναγνωρίζει τον κίνδυνο μία μελλοντική ΑΙ, να δει την Ανθρωπότητα ως ένα είδος εχθρού και να ξεκινήσει έναν πυρηνικό πόλεμο προς εξόντωσή της.

Πρόκειται για ουσιαστική επιβεβαίωση του σεναρίου των ταινιών Terminator του Τζον Κάμερον (που μαζί με τα Conan έκαναν διάσημο τον Άρνολντ Σβαρτζενέγκερ) κατά το οποίο κάποια στιγμή στο μέλλον η Τεχνητή Νοημοσύνη Skynet αυτονομήθηκε και θεώρησε την Ανθρωπότητα ως ένα «ιού» και εξαπέλυσε πυρηνικές επιθέσεις κατά της Ρωσίας.

Η Ρωσία φυσικά απάντησε (στις ταινίες) και η Ανθρωπότητα καταστράφηκε μέσα στον πυρηνικό όλεθρο.

Όπως αναφέρει ο Αμερικανός βουλευτής Τεντ Λιού: «Η ΑΙ είναι καταπληκτική και έχει κάνει τις ζωές μας καλύτερες, μπορεί όμως και να μας σκοτώσει. Όσο έξυπνη κι αν γίνει ποτέ δεν πρέπει να έχει έλεγχο πάνω σε πυρηνικά όπλα.»

Η πρωτοποριακή έρευνα του δρος Χίντον για τη βαθιά μάθηση και τα νευρωνικά δίκτυα άνοιξε το δρόμο για τα τρέχοντα συστήματα AI όπως το ChatGPT.

Όμως ο Βρετανο-Καναδός γνωστικός ψυχολόγος και επιστήμονας υπολογιστών είπε στο BBC ότι το chatbot θα μπορούσε σύντομα να ξεπεράσει το επίπεδο πληροφοριών που κατέχει ένας ανθρώπινος εγκέφαλος.

«Αυτή τη στιγμή, αυτό που βλέπουμε είναι οτι οι εξελίξεις όπως το μοντέλο γλώσσας GPT-4- επισκιάζουν ένα άτομο στο βαθμό των γενικών γνώσεων που έχει και το επισκιάζουν κατά πολύ.

Από άποψη συλλογισμού, δεν είναι τόσο καλό, αλλά το κάνει ήδη ένας απλός συλλογισμός. Και δεδομένου του ρυθμού προόδου, αναμένουμε ότι τα πράγματα θα βελτιωθούν αρκετά γρήγορα. Επομένως, πρέπει να ανησυχούμε για αυτό»

Στο άρθρο των New York Times, ο Δρ Χίντον αναφέρθηκε σε «κακούς ανθρώπους» που θα προσπαθούσαν να χρησιμοποιήσουν την τεχνητή νοημοσύνη για «κακά πράγματα». Όταν του ζητήθηκε από το BBC να δώσει περισσότερες λεπτομέρειες σχετικά με αυτό, απάντησε: «Αυτό είναι απλώς ένα είδος χειρότερου σεναρίου, ένα είδος εφιαλτικού σεναρίου.»

«Μπορείτε να φανταστείτε, για παράδειγμα, τι θα συνέβαινε αν κάποιος όπως ο [Ρώσος Πρόεδρος Βλαντιμίρ] Πούτιν αποφάσιζε να δώσει στα ρομπότ τη δυνατότητα να δημιουργήσουν τους δικούς τους επιμέρους στόχους». Ο επιστήμονας προειδοποίησε ότι αυτό μπορεί τελικά να «δημιουργήσει υποστόχους όπως «πρέπει να αποκτήσω περισσότερη δύναμη»».

Και πρόσθεσε: «Έχω καταλήξει στο συμπέρασμα ότι το είδος της νοημοσύνης που αναπτύσσουμε είναι πολύ διαφορετικό από τη νοημοσύνη που έχουμε. Είμαστε βιολογικά συστήματα και αυτά είναι ψηφιακά συστήματα. Και η μεγάλη διαφορά είναι ότι με τα ψηφιακά συστήματα, έχετε πολλά αντίγραφα του ίδιου συνόλου βαρών, του ίδιου μοντέλου του κόσμου.

Και όλα αυτά τα αντίγραφα μπορούν να μάθουν χωριστά, αλλά να μοιράζονται τη γνώση τους αμέσως. Έτσι είναι σαν να είχες 10.000 άτομα και όποτε ένα άτομο μάθαινε κάτι, όλοι το γνώριζαν αυτόματα. Και έτσι αυτά τα chatbots μπορούν να γνωρίζουν πολύ περισσότερα από οποιοδήποτε άτομο»

Ο δρ Χίντον είπε επίσης ότι υπήρχαν αρκετοί άλλοι λόγοι για να παραιτηθεί από τη δουλειά του. «Ο ένας είναι οτι είμαι 75. Άρα ήρθε η ώρα να αποσυρθώ. Ο άλλος είναι οτι πραγματικά θέλω να πω μερικά καλά πράγματα για την Google. Και είναι πιο αξιόπιστα αν δεν εργάζομαι για την Google.»

Πάντως σε ότι αφορά την χρήση της Τεχνητής Νοημοσύνης από «κακούς» ανθρώπους, αξίζει να σημειωθεί ότι πάνω σε αυτό στηρίζεται η υπόθεση των αριστουργηματικών μυθιστορημάτων του Frank Herbert, η σειρά Dune, όπου σε κάποιο σημείο του μέλλοντος φιλόδοξοι άνθρωποι πήραν τον έλεγχο των μηχανών που έκαναν τα πάντα πλέον και σκλάβωσαν την Ανθρωπότητα.

Εν συνεχεία βέβαια η Τεχνητή Νοημοσύνη υπερκέρασε και τους ανθρώπους εξουσιαστές και πήρε την θέση τους.

Γι’ αυτό τον λόγο οι άνθρωποι όταν επαναστάτησαν (Μπατλεριανή Τζιχάντ) και κέρδισαν πίσω τις ζωές τους εν συνεχεία δεν επέτρεψαν ποτέ ξανά την δημιουργία Τεχνητής Νοημοσύνης (στα βιβλία του Frank Herbert).

Μάλλον κάτι ήξερε ο συγγραφέας και ας τα σκέφτηκε την δεκαετία του ’60.

Tο pronews.gr δημοσιεύει κάθε σχόλιο το οποίο είναι σχετικό με το θέμα στο οποίο αναφέρεται το άρθρο. Ο καθένας έχει το δικαίωμα να εκφράζει ελεύθερα τις απόψεις του. Ωστόσο, αυτό δεν σημαίνει ότι υιοθετούμε τις απόψεις αυτές και διατηρούμε το δικαίωμα να μην δημοσιεύουμε συκοφαντικά ή υβριστικά σχόλια όπου τα εντοπίζουμε. Σε κάθε περίπτωση ο καθένας φέρει την ευθύνη των όσων γράφει και το pronews.gr ουδεμία νομική ή άλλα ευθύνη φέρει.

Δικαίωμα συμμετοχής στη συζήτηση έχουν μόνο όσοι έχουν επιβεβαιώσει το email τους στην υπηρεσία disqus. Εάν δεν έχετε ήδη επιβεβαιώσει το email σας, μπορείτε να ζητήσετε να σας αποσταλεί νέο email επιβεβαίωσης από το disqus.com

Όποιος χρήστης της πλατφόρμας του disqus.com ενδιαφέρεται να αναλάβει διαχείριση (moderating) των σχολίων στα άρθρα του pronews.gr σε εθελοντική βάση, μπορεί να στείλει τα στοιχεία του και στοιχεία επικοινωνίας στο info3@pronews.gr και θα εξεταστεί άμεσα η υποψηφιότητά του.